哎,不知道你有没有这种经历:脑子里一个绝妙的画面,拿起笔来,哼哧哼哧画了半天线稿,结果怎么看都觉得离想象中的样子差了一口气。要么是线条不够灵动,要么是想着上色就头大,最后那张画稿就永远停在了“草图”阶段,躺在文件夹里吃灰。嘿,别急着怪自己手残,现在这事儿可能真不完全是咱的问题。最近我深扒了一圈,发现AI在“线描画”这块儿已经进化到了让人惊掉下巴的程度。它们不再是那个只会把画面涂满颜色的“人工智障”,而成了能读懂你每一根线条意图的“细节控”伙伴。

痛点一:我的潦草手稿,AI能看懂吗?

我们手抖星人画出来的线条,歪歪扭扭不说,经常还会断点,自己过后都认不出来。拿这个去考验AI,不是难为它吗?你还别说,现在真有一些工具专治各种“手残”。

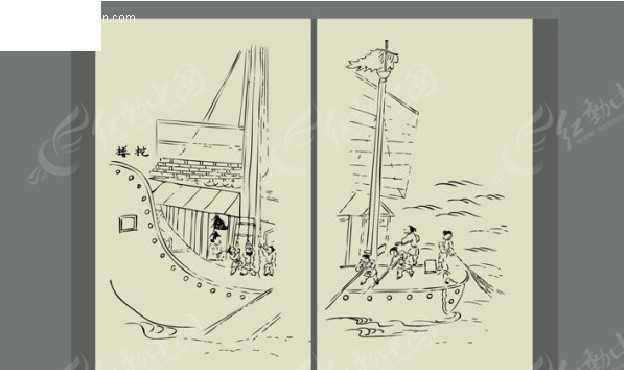

像SUAPP灵感渲染这类工具,就能把你在工地现场、匆匆画下的那些“鬼画符”式手稿,直接转换成干净利落的CAD线稿图-7。这功能对设计师来说简直是福音,量完房不用再对着手稿一根线一根线地重描了,AI能帮你把结构理得清清楚楚,甚至还能自动生成尺寸标注和室内布置方案-7。

对于更追求艺术感的动漫或插画线稿,则有像MistoLine这样的“全能选手”。它最大的本事是兼容几乎所有类型的线条输入,无论是铅笔素描的颗粒感,还是钢笔画的硬朗边缘,甚至是数码生成的线稿,它一个模型都能搞定,号称细节还原度能提升40%-6。这就好比一个超级翻译官,不管你的“线条语言”带什么口音,它都能准确理解,然后帮你输出成精致、连贯的画面。

痛点二:我想要那个感觉,但说不出来也画不出来!

“我想要那种…嗯…就是那种朦胧的、带点忧伤的、光影从窗户斜射进来的感觉…” 这种只可意会的描述,过去对AI来说就是对牛弹琴。但现在,情况变了。

Midjourney旗下专攻动漫的Niji模型,最近升级到了第七代(Niji 7),其中一个核心进化就是“提示词理解力暴涨” -2。它变得更“字面化”(Literal),你描述得越具体,它执行得就越精准-10。比如你输入“红色方块在左,蓝色方块在右”或者“四只手臂各拿一支冰激凌的女孩”,它都能一丝不苟地还原,逻辑不再崩坏-2。这意味着,你可以通过更精准的语言,来驾驭最后的画面细节。

那如果语言也匮乏呢?还有“风格参考”这招。Niji 7强化了--sref(风格参考)功能,你丢给它一张你喜欢的画作或角色,它就能更稳定地迁移那种画风-10。更硬核的还有像“LineArt”这样的研究框架,它直接模拟人类画家的创作过程:先分析线稿的结构层次,再像画油画一样,分“基础层塑形”和“表层着色”两步来渲染,目的就是最大程度保留你线稿中的精细结构,同时赋予你想要的材质和光影,解决了过去AI上色容易把细节糊掉的问题-4。

痛点三:效率是高了,但怎么保证每一张都“对味”?

用AI最怕的就是“开盲盒”,这次感觉对了,下次同样的提示词出来个“妖魔鬼怪”。尤其是在创作系列作品或者需要角色一致性的项目里,这问题能逼死强迫症。

这时候,追求“一致性”和“可控性”的工具就派上了用场。前面提到的Niji 7,其升级重点之一就是“画面连贯性”,特别是在人物面部和眼睛高光等细微处,能保持前所未有的清晰和一致-10。这让你反复生成同一角色时,不会出现“昨天是桃花眼,今天变死鱼眼”的惨剧。

而对于需要批量处理、统一风格的项目,比如动漫制作,效率工具则是另一番景象。国内之前有过像“喵图”这样的应用,主打就是为动漫线稿智能上色。它展示过一个惊人的数据:传统上色师一天完成20-30张图,而用他们的AI,渲染一集动画所需的上万张图,理论上只需150分钟,效率提升以千倍计-5。当然,它通常需要针对特定作品风格进行训练,并非通用工具,但这种“专精”带来的正是稳定的产出质量。

聊聊感受:AI线描画,到底改变了什么?

用了这么多工具,我的感觉是,“AI线描画”这个概念,正在从一种“替代性”技术,变成一种“增强性”的创作维度。它不再仅仅是把黑白变彩色的“上色员”,而是一个能理解结构、演绎风格、强化细节的“全能副手”。

最让我感慨的是,它解决了一些很根本的创作痛苦。比如,它把我们从重复、机械的劳作中解放出来(想想给复杂线稿铺底色、分图层),让我们能更专注于创意本身:构图、叙事、情感表达。同时,它也降低了一些技术门槛,让那些擅长构思但不精于绘画技法的人,也有了快速实现视觉化的可能。

当然,它绝不是“一键成神”的魔法。用好这些工具,反而要求我们更懂“沟通”:要么精进提示词,成为“语言魔法师”;要么深化对画面结构的理解,以便给AI提供更精准的线稿。这个过程,本身就是在反向提升我们的艺术修养。

总而言之,现在的AI线描画工具已经织起了一张细密的网,无论你的痛点在于“草稿太乱”、“想法太玄”还是“量产太难”,似乎都能找到对应的解决方案。这场由算法掀起的绘画革命,正悄悄地把我们从“技”的束缚中松绑,或许,真的能让我们离心中那个完美的画面更近一点。这感觉,真是老嗲额!