嘿,各位科技先锋们,注意力集中!美西时间12月2日早8点,被誉为“云计算春晚”的亚马逊云科技 re:Invent 2025大会迎来关键时刻。首席执行官 Matt Garman在两个小时的高密度演讲中,连番发布了一系列重磅产品与服务。

自研AI芯片Trainium和Nova模型确实夺目,它们代表了行业关注的上下两极——上至模型竞争,下至芯片厮杀。模型排行榜战火不断,AI芯片领域英伟达与谷歌TPU等强敌环伺。人们常常忽略一个关键事实:

单靠模型和芯片,根本无法实现大模型商业化的正向循环。要让大模型真正创造价值,必须在硬件与软件的每一层进行深度优化。芯片和模型是重要组成部分,但绝非全部。

“而这正是只有亚马逊云科技能做到的。事实证明,没有捷径可走。”Matt Garman的断言掷地有声。

Matt Garman的底气究竟从何而来?

Matt Garman的三个灵魂拷问,揭开AI产业的真正拐点

无论是推出首个产品S3,还是AI重塑一切的今天,亚马逊云科技始终坚守第一性原理。

Matt Garman强调,驱动我们的核心,是赋予每个人自由创新的能力。这从亚马逊云科技诞生之日起便是使命。我们希望让宿舍里的学生、车库里的创客,都能获取所需的技术、基础设施与能力,去构建他们梦想的一切。

二十年前,这几乎是天方夜谭。开发者难以在不耗费巨量时间和资金的情况下获得服务器或算力。他们疲于采购服务器、管理基础设施,而非专注于真正的创新构建。

“为什么开发者不能专注构建,而非纠缠于基础设施?为什么不能将实验成本与时间降至近乎零?为什么不能让每一个创意都成为可能?”Matt Garman的这三个问题,正是亚马逊云科技始终回答的核心。

过去二十年,亚马逊云科技几乎实现了这一愿景。如今,它已成长为规模达1320亿美元的业务,同比增长加速至20%。仅过去一年,营收就新增220亿美元,绝对增长值超过半数《财富》500强企业的全年收入。

亚马逊云科技拥有全球规模最大、部署最广的AI云基础设施。其数据中心网络覆盖38个区域、120个可用区,并已规划新增三个区域。过去一年,新增数据中心容量达3.8吉瓦,位居全球之首。

但技术永无止境。大模型浪潮袭来,开发者们再次面临那些老问题。“我们仍处于AI未来的早期阶段,技术迭代速度前所未有。不久前,我们还在测试聊天机器人,如今几乎日新月异。但与客户交流时,包括在座各位,你们尚未看到与AI承诺匹配的回报——AI的真正价值还未完全释放,不过变革正在加速。”Matt Garman说。

坦率说,初期亚马逊云科技在模型和芯片层未展现碾压优势,市场预期曾有所回落。随着大模型加速落地,一个真正的拐点浮现——AI Agent。

AI助手正逐渐让位于AI Agent。它们能理解意图、执行任务并自动处理工作流,正是在此阶段,企业开始从AI投资中获得实质回报。

“我相信,AI Agent正将我们带到AI发展的关键拐点。AI正从技术奇观转变为真正创造价值的能力。”Matt Garman甚至将AI Agent类比为互联网或云的诞生。“未来,每家公司、每个可想象领域都将运行数十亿个Agent。”

由此可见,亚马逊云科技的真实意图,并非简单替代英伟达或谷歌而做Trainium芯片,也非为击败OpenAI和Anthropic而做Nova模型。它真正关心的是——

在Agentic AI时代,如何重构AI基础设施、提供更优模型选择,以及部署Agent至关键业务场景所需的完整工具链与平台。

AI基础设施:双线作战,既要英伟达GPU,也要自研Trainium4

Agent发挥价值的先决条件是强大的AI基础设施。“你需要最具扩展性、最强大的AI基础设施驱动一切。必须拥有高度可扩展且安全的云,为AI工作负载提供最佳性能,并在模型训练、定制及推理全流程中,以尽可能低的成本实现能力。”Matt Garman指出。

GPU仍是AI基础设施的核心。Matt Garman强调,亚马逊云科技是运行GPU的最佳平台。作为首家在云上提供GPU的厂商,其在大型GPU集群的稳定性与可靠性上建立了行业领先优势,甚至精细到调试BIOS以避免GPU重启。

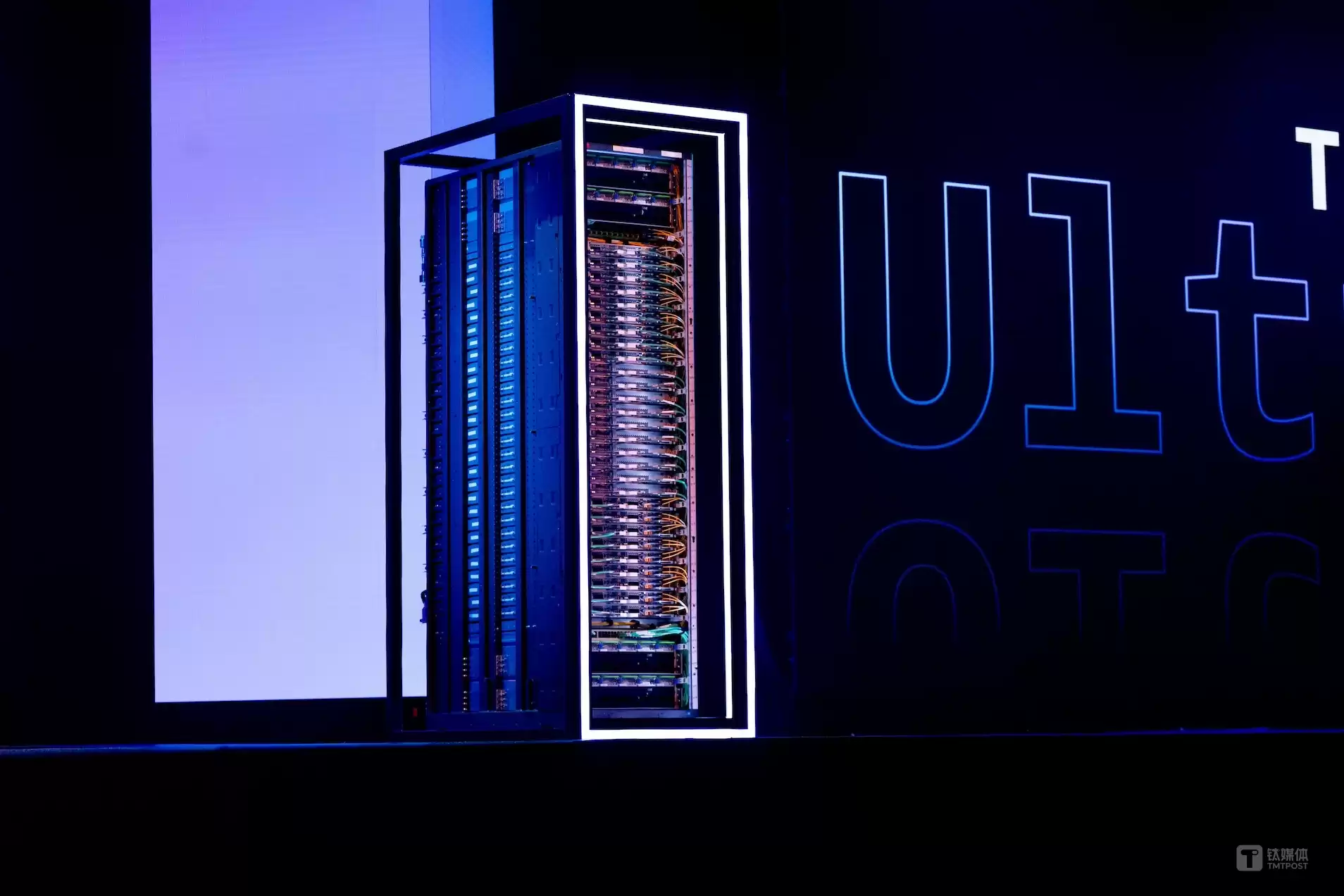

全新P6E GB300系列正式发布,采用英伟达最新的GB300 NVL72系统。英伟达自身的大规模GenAI集群Project Ceiba就运行在亚马逊云科技上;OpenAI也积极使用亚马逊云科技支撑其核心业务。

据悉,OpenAI等企业正使用拥有数十万颗GPU的EC2 UltraServers集群,目前基于GB200,即将升级至GB300系列。他们还将规模扩展至数千万级CPU,以管理庞大Agent工作流,支撑ChatGPT等应用的全球访问,并训练下一代模型。

本次推出的Amazon AI Factories是大型企业瞩目的基础设施形态。通过它,客户可在自有数据中心内部署由亚马逊云科技提供、完全独享的AI基础设施。

简言之,AI Factories是“客户专属的亚马逊云科技私有区域”——客户利用已有数据中心空间与供电能力,同时仍能访问亚马逊云科技领先的AI训练集群、最新Nvidia GPU,以及Amazon SageMaker、Amazon Bedrock等核心AI服务。

AI Factories为单一客户独立运行,提供物理与逻辑的严格隔离,保持与亚马逊云科技一致的安全性、可靠性与可用性,并满足各地合规与数据主权的最高标准。

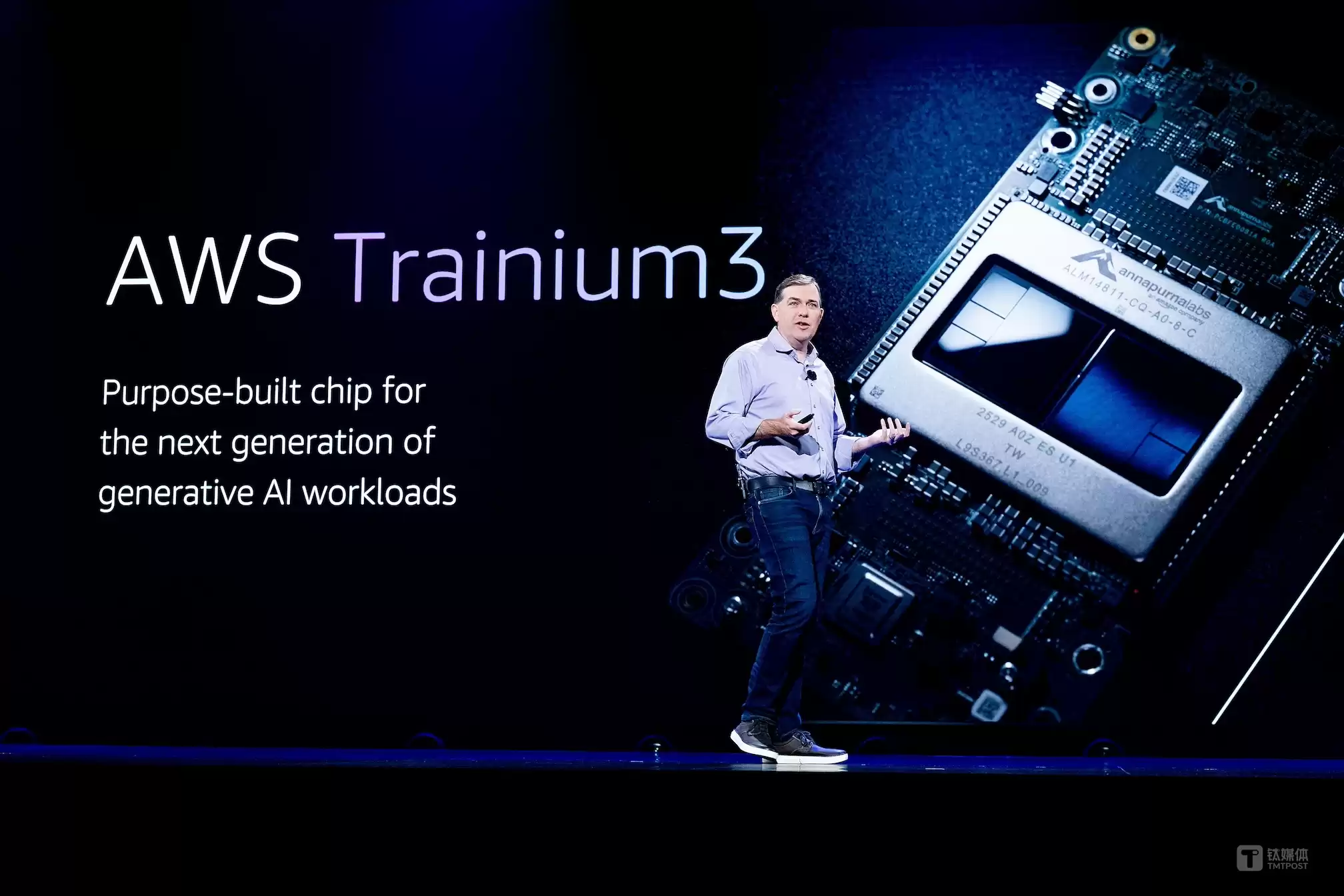

接下来是备受关注的AI芯片。亚马逊云科技已构建覆盖训练、推理和通用计算的完整算力矩阵。Trainium是专为AI工作负载研发的芯片,许多人以为它只是训练芯片,实则不然——Trainium 2已成为全球性能最强的推理系统之一。

如今,Amazon Bedrock上大部分推理任务由Trainium驱动。例如,企业客户在Bedrock上使用最新Claude模型,推理全部运行在Trainium上,并提供业界领先的端到端响应速度。

据悉,亚马逊云科技已部署超过100万颗Trainium芯片。之所以能快速部署百万规模,得益于其端到端优化整个技术栈,从芯片、系统、网络到数据中心,部署效率极高。

Matt Garman透露:“我们在数据中心部署Trainium2的速度,比过去任何芯片快数倍。这是我们迄今最快的AI芯片部署,销售速度几乎与产能持平。仅训练芯片部分,今天已是数十亿美元规模业务,且快速增长。”

去年官宣的新一代芯片Trainium 3迎来新进展:Trainium 3 UltraServers正式可用,这是行业最先进的服务器之一,搭载亚马逊云科技首款3纳米AI芯片,为大规模AI训练与推理提供领先性价比。

与Trainium 2相比,Trainium 3实现显著飞跃:计算能力提升4.4倍、内存带宽提升3.9倍,每兆瓦功耗可处理的AI tokens数量提升5倍。最大规格EC2 Trn3 UltraServers能将144颗Trainium 3芯片构建为单一scale-up域,通过定制Neuron Switch网络互连,在单个实例中提供362 FP8 petaFLOPS算力及超过700 TB/s聚合带宽。

在更大规模上,其自研EFA网络可将能力扩展至数十万颗芯片组成的超大规模集群。行业基本无其他厂商能实现,因为这需系统层级全面协同:包括多类型定制芯片、同时具备scale-up与scale-out的网络体系、深度集成软件栈及领先数据中心基础设施。

实际测试中,Trainium 3优势更直观。亚马逊云科技将已在Trainium 2上优化的模型权重迁移至Trainium 3,并对多种开源模型开展推理测试。例如,在OpenAI的GPT-OSS模型上,Trainium 3在保持相同单用户延迟前提下,每兆瓦功耗可产出的tokens数量提升超过5倍。

亚马逊云科技现场预告下一代芯片——Trainium 4已进入深度设计阶段。与Trainium 3相比,Trainium 4在关键指标上大幅提升:FP4计算性能提升6倍、内存带宽提升4倍,高带宽内存容量提升2倍,以满足未来超大规模模型训练需求。

模型自由:自研Nova升级、生态扩容,还有革命性“开放式训练模型”

要构建企业级Agent,首要挑战是模型选择——如何在性能、时延与成本间取得最佳平衡。实践中,“只选一个模型”往往非最优解,更有效的是针对不同任务灵活组合多种模型。

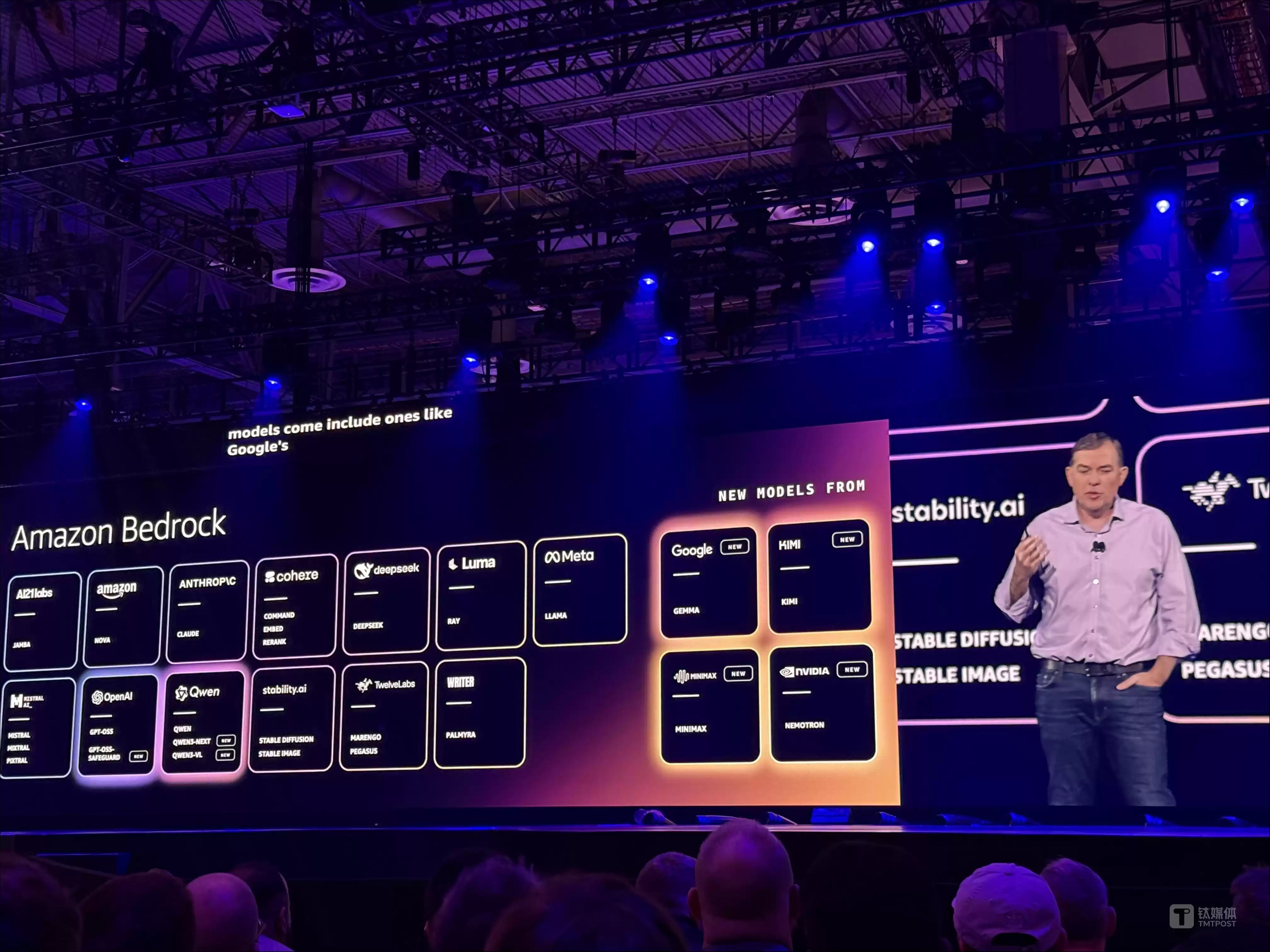

亚马逊云科技相信,未来不会出现“通吃所有任务”的单一模型,而是各类优秀模型长期并存。其策略是持续扩展可用模型范围,涵盖开源与专有、通用与专业、大模型与小模型。今年,Bedrock上模型数量较去年几乎翻番。

Amazon Bedrock是一套完整的生成式AI平台,旨在帮助企业从原型快速迈向生产级应用。企业能在Bedrock中选择最适配模型、基于需求定制性能、将模型与业务数据深度整合,并灵活加入安全机制。所有能力均运行在AWS全面安全体系之上。

目前,Bedrock已被BMW、GoDaddy等全球客户广泛采用。与去年同期相比,构建在Bedrock上的客户数量增长超过两倍;已有逾50家客户单日处理token数量突破1万亿,使用场景覆盖众多超大规模应用。

本次大会,亚马逊云科技进一步扩展开源模型生态,正式引入包括Google Gemma MiniMax M2、kimi k2、NVIDIA Nemotron在内的一系列新模型。同时,来自Mistral AI的最新开源权重模型也将登陆Bedrock,包括Mistral Large 3、Mistral 3(3B/8B/14B)。

自研模型层面,Amazon Nova系列全面升级至Nova 2。过去一年,Nova系列在多模态、语音与嵌入向量等方向全面扩展,已被数万家客户使用。

Nova 2提供具备前沿智能、成本优化和低延迟表现的模型。Nova 2 Light是一款快速且高性价比推理模型,适用于广泛生产级任务。在指令遵循、工具调用、代码生成、文档抽取等关键领域,其表现可与Claude Haiku 4/5、Gemini Flash 2.5等模型媲美甚至更优,并保持显著成本优势。

Nova 2 Pro是智能推理模型,专为复杂任务与高级Agent能力构建,其在指令理解、工具调用等核心领域的人工评测表现领先于GPT 5.1、Claude 4.5 Sonnet。

Nova 2 Sonic是新一代speech-to-speech模型,具备更自然对话质量、更低延迟、更广语言覆盖与更优成本结构,适用于语音交互类应用。

Nova 2 Omni是业内首个同时支持文本、图像、视频、音频输入,并能生成文本与图像输出的统一多模态推理模型。它可在单一模型中完成全链路理解与生成,大幅降低组合多模型的复杂度。

接下来是一个突破性产品:Amazon Nova Forge,即开放式训练模型。

尽管现有模型强大,但企业真正竞争力源于专有数据与行业知识。当前主流方法如RAG与向量检索虽能提升效果,仍受限于无法让模型真正“内化”企业独特数据体系。

企业通常面临两难:从零训练基础模型——成本极高,不切实际;基于开源模型微调——效果受限,且存在遗忘核心能力的风险。

亚马逊云科技思考:能否在“正确的训练阶段”将企业数据注入模型,使其既保留前沿模型通用能力,又具备企业独有的专业理解?

答案就是Amazon Nova Forge。

Nova Forge首次实现“开放式训练模型”理念:企业可访问多个Nova训练阶段检查点,在训练的每一阶段,将自有数据与亚马逊甄选数据深度融合,最终获得仅供企业私有的专属模型(novella),可直接部署到Amazon Bedrock。

模型不仅保留核心推理能力,还能原生理解企业的历史数据、行业规律、流程约束与IP资产。

以硬件制造企业为例,企业拥有数十亿token、数百GB历史设计、制造经验与故障案例数据。通过从完成约80%预训练的Nova 2 Light检查点出发,将企业数据纳入剩余训练过程,模型可自然学习其行业知识体系。Nova Forge支持强化学习、远程奖励函数等机制,使模型能基于企业真实业务闭环不断优化。

Agent进军关键生产场景:需要哪些武器库?

讲完上层模型和底层芯片,Matt Garman的重头戏才过半。如何将Agent部署至关键业务场景?亚马逊云科技先推出一系列工具,再亲自演示自身Agent应用。

Agent能执行任务、采取行动、动态推理,并自主创建工作流以达成目标。其非确定性运行方式正是价值所在。但同时,传统软件时代的工具链与基础设施,已无法满足自主智能时代需求。

基于此,亚马逊云科技推出Amazon Bedrock AgentCore——一个面向企业级场景、专为Agent构建的身份与执行平台。AgentCore架构高度模块化且端到端安全。它提供Serverless安全运行时环境,支持Agent间相互调用,并具备完整会话执行能力。

AgentCore的隔离式记忆机制可同时管理短期与长期上下文,使Agent能在真实业务环境中持续积累经验、不断优化表现。借助AgentCore,企业可在私有Amazon VPC中安全部署Agent,并可轻松扩展至数千并发会话,应对高流量场景。通过拖拽或数行代码,一分钟内即可部署可运行Agent。

据介绍,AgentCore客户采用速度正呈指数级增长,覆盖多个高监管行业与技术密集领域,包括Visa、澳大利亚国民银行、力拓集团,以及Palumi、ADP等独立软件厂商和初创企业Cohere Health等。

例如,NASDAQ正基于AgentCore快速构建面向核心业务的Agent。采用前,NASDAQ计划投入整个工程团队构建底层基础设施;现在,这些工作由AgentCore接管,使其能聚焦Agent能力本身。

如何确保Agent行为可预测,并严格对齐用户意图?这是企业客户的另一大担忧。Agent的强大源于推理与自主能力,但这也意味着传统静态规则无法有效约束其动态行为。就像培养青少年,需在给予自主性时设立清晰边界,以防重大风险。

虽然企业可在Agent代码中编写访问限制,但由于Agent在运行时动态生成和执行代码,这类限制并不可靠,更难以审计。许多企业不放心将Agent用于关键业务流程。

为此,亚马逊云科技推出Policy in Amazon Bedrock AgentCore,确保Agent行为可控与可审计。这是一套实时、确定性、可验证的策略执行系统,用于规范Agent与企业工具及数据的交互方式。

企业可精细定义:Agent可访问哪些工具与数据;可调用哪些具体能力;在何种条件下可执行哪些操作。对内部API、Lambda、MCP服务器与Salesforce、Slack等第三方服务实现统一管控。策略甚至可用自然语言编写。

简单例:“当退款金额超过1000美元时,禁止执行退款操作。”系统自动将规则转换为开源策略语言,并在Agent Gateway中以毫秒级速度评估。所有Agent行为在访问工具或数据前均受策略校验,确保严格在企业设定边界内运行。

构建Agent过程中,仅监控运行指标不够。企业还需回答核心问题:Agent决策是否正确?是否调用最合适工具?回答是否符合合规与品牌要求?模型升级后能否保持行为一致性?

传统做法需数据科学家搭建复杂评估系统,维护大量基础设施。即便有测试环境,也难以预测Agent在真实世界表现。

为解决此,亚马逊云科技推出AgentCore Evaluations,让企业能基于真实行为持续评估Agent质量。

Evaluations支持针对正确性、有用性、无害性等维度自动评估;使用预构建评估器或自定义模型与提示词;在模型升级前后运行一致性验证;在生产环境捕捉质量下降。

所有评估结果直接展示在CloudWatch中,与AgentCore可观测性指标统一呈现。这将过去需专业团队与复杂基础设施的工作自动化,使任何团队都能轻松构建高质量、可提升的Agent。

另一核心挑战是技术债。埃森哲测算,仅在美国,技术债年成本高达2.4万亿美元;Gartner数据显示,企业多达70% IT预算花在维护遗留系统上。

亚马逊云科技推出Amazon Transform,帮助客户从VMware、大型机及Windows .NET等遗留平台迁移。在大型机现代化方面,客户已借助Transform分析超10亿行大型机代码,并将关键系统逐步迁移至云端。

但遗留系统形态远不止此,还包括Lambda函数升级、Python版本提升、Postgres升级、从C迁移至Rust等。企业内部存在大量高度定制、难以标准化的升级需求,如内部自研语言、专属API、私有框架或特定版本库升级。

因此亚马逊云科技提出关键问题:为什么不支持所有现代化需求?

在拉斯维加斯,亚马逊云科技将一架退役旧服务器机架吊起并当场引爆,象征彻底告别技术债的决心与愿景。

同时,正式推出Amazon Transform自定义功能。它允许客户针对任意代码、API、框架或运行时构建现代化转换流程。开发者可轻松创建专属代码转换Agent,实现对任何语言、内部库及独有框架的自动化现代化。

亚马逊云科技自造了哪些王牌Agent?

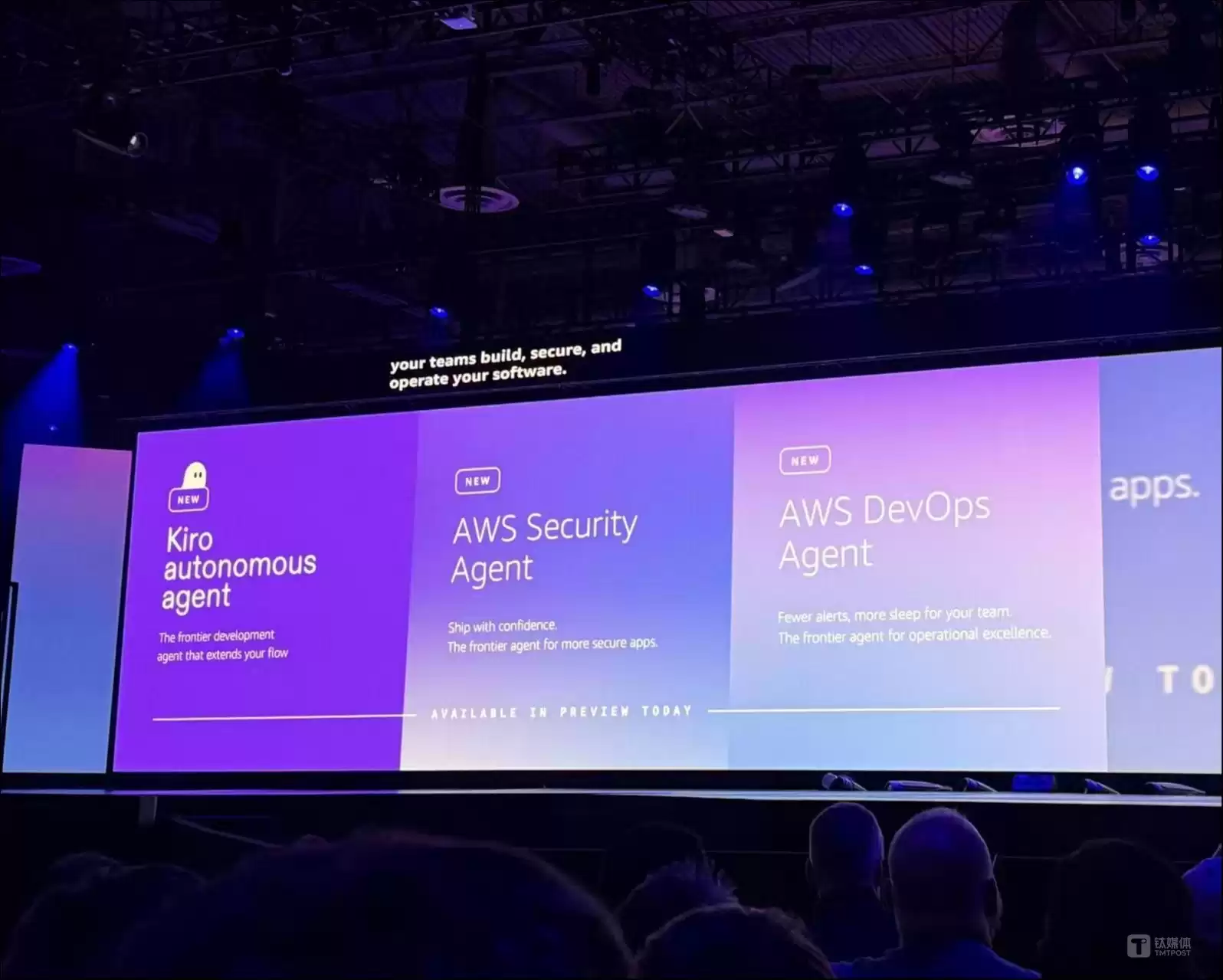

亚马逊云科技自身场景丰富,其最新Agent阵容一并亮相。首先是Kiro,一个面向结构化AI编码的Agent开发环境。

Kiro能将自然语言指令转化为具备工程可执行性的规范文档,并由高级Agent自动生成完整、可运行代码,确保最终产出质量与一致性。它能理解提示背后意图,在大型代码库中高效执行复杂功能开发,显著减少人工拆解与沟通步骤。

自数月前启动预览,Kiro已吸引数十万开发者试用。上周,亚马逊决定全面采用Kiro作为公司内部官方AI开发环境。Matt Garman表示,评估所有主流工具后,他们认为最大化开发者效率的最佳方式就是加大对Kiro投入。

一位亚马逊工程师负责的大型重构项目,最初评估需30名开发者、18个月完成。全面采用Kiro后,团队通过调整工作流、提高任务并行度、充分发挥Agent能力,最终仅用6名开发者、76天即完成整个项目。

在此基础上,亚马逊云科技发布Kiro自主Agent。它能独立处理日常开发工作:交付新功能、诊断bug、提升代码覆盖率,所有操作在后台完成,还能与Jira、GitHub、Slack等现有工具集成。

Kiro自主Agent就像团队新成员,会学习你的工作偏好,不断加深对代码、产品及团队规则的理解。随时间推移,它将行为、修改、讨论和Pull Request交织,形成“集体记忆”,推动团队实现更智能开发方式。

随着开发加速,仅加速代码生成不够,安全必须同步扩展。基于Kiro自主Agent经验——目标导向、并行扩展、增强自主性,亚马逊云科技推出Amazon Security Agent。

它将安全专业知识前置,确保开发周期每一步遵循最佳安全实践,包括:设计文档审查,在写第一行代码前识别潜在风险;PR安全审查,在GitHub工作流中即时反馈安全问题;按需渗透测试,将传统缓慢昂贵流程转为随需执行;修复建议,提供直接可用安全方案;多应用并行测试,同时验证多个系统,消除瓶颈。

例如,当开发者误用信用卡数据存储方式,Amazon Security Agent可在早期检测风险,防止返工或严重问题。通过将安全融入日常开发流程,它让快速开发与安全发布兼得。

开发完成后,运维规模与复杂度随之增加。亚马逊云科技推出Amazon DevOps Agent。它像高级DevOps工程师,主动识别问题、分析根因、提供优化建议,并支持跨云与混合环境操作。

某种程度上,亚马逊云科技本身就是一家软件公司。Kiro自主Agent、Amazon Security Agent、Amazon DevOps Agent共同覆盖软件生命周期核心环节,因此成为其优先落地的业务场景。

纵观大会,Agent的出现将AI从技术奇观变为企业生产力新引擎。亚马逊云科技在re:Invent 2025展示的,不仅是芯片、模型或单一技术领先,更是一整套面向Agentic AI时代的完整解决方案。

从底层AI基础设施、训练与推理芯片,到灵活多样的自研与开源模型,再到面向开发、安全与运维的全生命周期Agent,亚马逊云科技正通过端到端技术协同,重新定义企业级AI的可落地能力。

未来AI竞争,既关乎算力或模型参数比拼,更关乎谁能真正让AI在业务中高效执行任务、持续创造价值。这正是亚马逊云科技在芯片和模型之间提供的“中间层”能力,也是其构筑的护城河。(本文作者 | 张帅,编辑 | 盖虹达)

相关问答

云技术究竟是对哪些技术的融合与升级?

云技术是对并行计算、网格计算、分布式计算等技术的深度融合与创新运用。云计算作为分布式计算的一种,通过“云”网络将庞大计算处理程序分解成无数小程序,由多服务器协同完成。

云计算的未来将走向何方?-ZOL问答

当前云计算无疑是最热门技术之一。但当发展趋于成熟,对云服务而言,最关键已非计算速度,而是云端数据安全——这将是决定未来的核心战场。

云计算技术与应用的发展前景如何?

云计算技术前景广阔。作为产业互联网关键技术,它将全面渗透各产业领域。其核心是通过互联网为用户提供弹性、可扩展的计算资源与服务。

云计算是互联网演进到第几阶段的产物?

云计算是互联网发展到第三代的标志性成果。它属于分布式计算,通过“云”网络将海量数据计算分解,由多服务器集群协同处理。

云计算发展经历了哪些关键阶段?-ZOL问答

第一阶段:1946-1956年,电子管计算机时代。1946年第一台电子计算机诞生于宾夕法尼亚大学,由冯·诺依曼设计,占地170平方米,功耗150KW,速度慢且不稳定。

云技术如何推动会计信息系统变革?_注册会计师_帮考网

云技术显著提升会计信息系统数据处理能力,实现实时数据共享,降低运营成本,提高整体效率。

云计算发展面临哪些技术挑战?

1. 云数据中心布局尚不合理,资源利用率偏低。数据显示,中国大规模数据中心比例仍低,大型规模甚至不及国外单一互联网公司总量。

5G+云存储技术将如何演进?对移动终端本地存储有何冲击?

谢谢邀请。1、5G+云存储技术趋势向好。5G更快的网络速度势不可挡,将在车联网等领域发挥关键作用;云计算技术正持续革新。

云计算与大数据,哪个就业前景更胜一筹?

云计算和大数据都是就业热门领域。个人更倾向大数据,因其涵盖面广,也包括部分云计算内容。两者均前景可观。

人工智能腾飞的三大助推力是什么?

第一:产业结构升级驱动。产业持续升级是AI发展关键因素。网络化、信息化、智能化是传统行业升级核心,因此人工智能产业前景光明。