哎,你是不也有过这种经历?脑壳里想得之巴适、之完美的一个画面,丢给AI生图工具,生成出来一看——整体感觉是对嘞,但总有那么一两个地方“不对头”!要么是左下角那排艺术字糊成了一团,要么是主角的袖口颜色跟背景融得莫得层次-1。想改?要么费劲巴拉地拖进PS,用钢笔工具和蒙版一点点“刮”,要么就只好全部推倒重来,在提示词里再加点“魔法咒语”,然后开始新一轮的“抽卡”祈祷-1。这种挫败感,简直让人想摔键盘!

莫慌,这种“生成即定稿”的憋屈日子,可能要翻篇了。最近,一场围绕“ai图片到图形里”的技术进化正在悄悄发生,它的核心就一句话:把你生成的整张图片,智能地“拆解”成一个个可以独立编辑的图形元素。这可不是简单的抠图,而是一场从“不可控”到“精准控”的创作革命-1-4。

一、痛点终结:从“抽卡赌博”到“可控编辑”

以往我们抱怨AI生图工具是“黑箱”,最大的痛点就在于那个无法编辑的“结果图”。你得到的是一张完美的、但也是凝固的“照片”,想调整其中任何一个小元素,都难如登天-1。

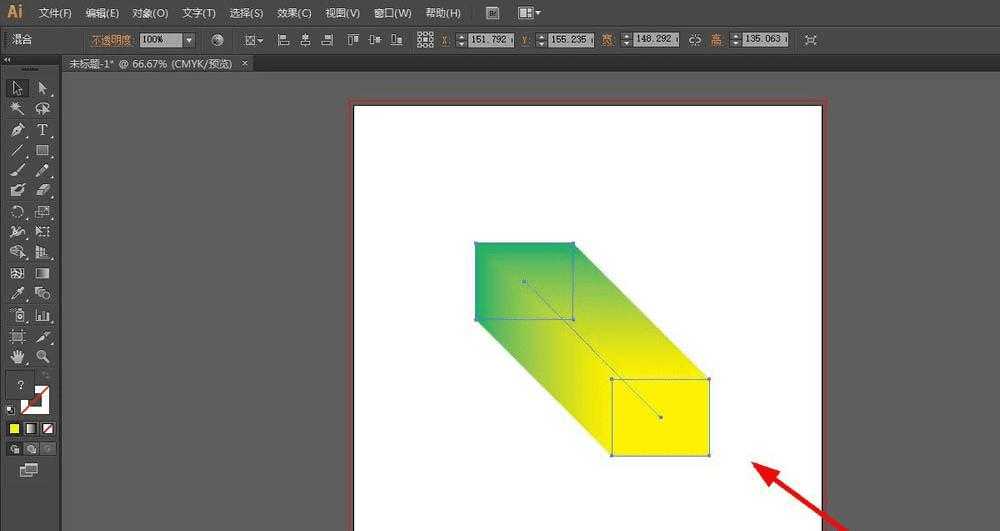

现在,像Lovart AI的“编辑元素”(Edit Element)和Adobe Firefly Image 5演示的“分层编辑”这样的功能,就是在直接猛攻这个痛点-1-4。它们的操作逻辑直观得令人感动:上传你的AI生成图,点一下按钮,AI就开始像一位拥有透视眼的设计师助理,自动把图片里的文字、人物、前景、背景、装饰物……分门别类地归置到不同的图层里-1。

这个过程,正是第一次关键的“ai图片到图形里”。它把一张扁平的位置图,还原成了一个有结构、有层次的“图形项目”。于是,魔法发生了:你可以单独选中那个糊掉的文字图层,重新编辑内容或更换字体;可以单独拖拽人物的位置,而AI会自动为你补全合理的阴影和背景衔接-4;甚至可以一键替换掉整个背景,从都市街头瞬间切换到落日海滩,而主体毫发无损-1。这意味着,创作流程从“一次性生成+反复重来”,变成了“一次性生成+无限精细调整”,控制权被大大交还到了创作者手中。

二、能力进化:不仅是分层,更是“理解”

如果只是机械地分图层,那还只是高级一点的抠图工具。真正的飞跃在于,新一代的模型在尝试“理解”图片里的语义关系。这就要说到更深层次的“ai图片到图形里”了。

阿里开源的Qwen-Image-Layered模型给出了一个更极致的想象-10。它不仅能分解图层,还能实现“递归分解”——你可以对分出来的某个图层(比如一辆汽车)再次下达分解指令,把这辆车进一步拆成车轮、车身、车窗等独立部件-10。这种能力,源自于它独特的训练方式:直接从专业的PSD设计源文件中学习-10。这相当于让AI在“母带”级别上,观摩了成千上万次专业设计师是如何思考图层结构和物件关系的。

这让“编辑”拥有了前所未有的自由度。比如在汽车内容创作中,编辑可以轻松分离出车辆的每一个改装件进行特写展示;在线购车配置器可能实现真正的“所见即所得”,因为车辆本身已是一个可被精准操控的独立图形集合-10。这背后的实质,是AI对图像从“像素级”的识别,进化到了“对象级”乃至“语义级”的理解与管理。

三、暗流涌动:一场“猫鼠游戏”悄然开场

就在我们为能够自由编辑AI图片而欢呼时,另一条技术战线上的较量也愈发激烈——那就是AI生成图片的检测与反检测。

目前,专业的检测框架(比如基于集成学习的方法)识别AI生成图像的准确率已经非常高,能达到98%以上-2。它们通过分析图像在频率谱、纹理一致性等人类肉眼难以察觉的维度上的微小特征,来做出判断-2-5。

但正所谓“道高一尺,魔高一丈”。像StealthDiffusion这样的反检测技术也在发展,它通过在稳定扩散模型的潜在空间中添加精心优化的对抗性扰动,能够生成“人眼难辨、检测器也难辨”的图片-5。其目标是同时欺骗机器和人类的双眼-5。

这场博弈带给普通用户的启示是:未来,单纯讨论一张图“是不是AI生成的”可能会变得越来越难,也越来越不重要。更重要的是图片的用途和版权状态。那些使用明确无版权或开源协议素材(如Public Domain 12M数据集中的图片)来训练和生成图片的工具,其产出的内容在商业应用上将更具安全性和合法性优势-3-6。

四、未来展望:你的创意,才是唯一的边界

所以,“ai图片到图形里”这场变革,最终把我们引向何方?

它绝不仅仅是提高效率。它降低的是执行的门槛,抬高的却是创意的天花板。它把创作者从繁琐、重复、高技巧要求的“像素劳作”中解放出来-10。就像当年数码相机和Photoshop的普及,并没有淘汰摄影师,而是让更多人能专注于光影、构图和故事本身。

未来,一个创作者的工作流可能是这样的:用一段充满想象力的提示词,快速生成一个基础场景和角色(第一次从0到1的创造)。通过“ai图片到图形里”技术,将其解构成一个个可编辑的图形元素(第二次从凝固到解构的创造)。接着,像搭积木一样,自由组合这些元素,更换风格、调整构图、迭代细节(第三次从解构到重组的创造)。甚至,可以将这些高质量、可分层的元素存入自己的“创意资产库”,在未来不同的项目中反复调用和衍生。

到那时,工具将真正成为思想的延伸。技术负责解决“如何实现”,而人,只需要专注于那个最本源、也最珍贵的问题:“我想创造什么?” 这场始于编辑便利的革新,最终指向的,是一个创意更加澎湃、表达更加自由的新世界。